菜单

一、3060显卡部署4B模型

模型文件下载

modelscope download --model cyankiwi/Qwen3.5-4B-AWQ-INT8-INT4vllm启动

shell>>TOKENIZERS_PARALLELISM=false vllm serve /data/app/qwen3.5-4b --port 8000 --host 0.0.0.0 --trust-remote-code --gpu-memory-utilization 0.85 --max-model-len 35536 --kv-cache-dtype fp8 --enforce-eager --served-model-name qwen3.5-4b --api-key sk-1234567890abcdef --enable-auto-tool-choice --tool-call-parser qwen3_xml二、生产环境双4090显卡部署Qwen3.6-35B-A3-FP8

2.1 环境安装

- 安装好conda环境和显卡驱动环境

- 创建conda环境,建议优先选择用python=3.10

- pip install vllm

- 下载模型文件

2.2 4090显卡调优

# 1. 彻底禁用 P2P 和一些可能导致 4090 卡死的通信优化

export NCCL_P2P_DISABLE=1

export NCCL_IB_DISABLE=1

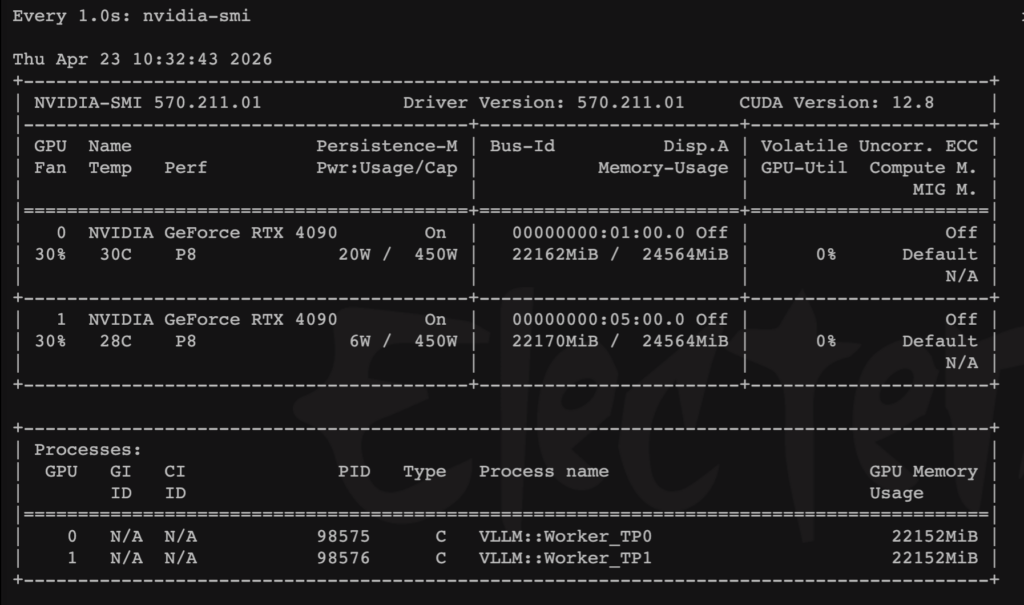

export VLLM_USE_V1=0 # 强制回退到稳定的 V0 引擎2.3 双4090显卡部署qwen3.6-35B-FP8

(vllm) admin-xy@xy-ai-server:/DATA/app/Models/qwen3.6$ python -m vllm.entrypoints.openai.api_server \

--model /DATA/app/Models/qwen3.6 \

--tensor-parallel-size 2 \

--gpu-memory-utilization 0.90 \

--max-model-len 32768 \

--trust-remote-code --enforce-eager \

--served-model-name qwen-3.6 \

--host 0.0.0.0 --port 8000\

--enable-auto-tool-choice --tool-call-parser qwen3_coder \

--api-key sk-1234567890abcdef

部署成功,现在封装成一个服务

2.4 封装系统服务

创建日志目录

shell>>>touch /DATA/app/vllm/logs/vllm.log

shell>>>sudo chown admin-xy:admin-xy /DATA/app/vllm/logs/vllm.log

shell>>>sudo chmod 644 /DATA/app/vllm/logs/vllm.log创建服务文件

shell>>>>sudo vim /etc/systemd/system/vllm-qwen.service

[Unit]

Description=vLLM Qwen3.6-35B OpenAI API Server

After=network.target nvidia-persistenced.service

[Service]

User=admin-xy

Group=admin-xy

WorkingDirectory=/DATA/app/vllm

# 你的Python绝对路径(已填好)

ExecStart=/DATA/app/conda/envs/vllm/bin/python -m vllm.entrypoints.openai.api_server \

--model /DATA/app/Models/qwen3.6 \

--tensor-parallel-size 2 \

--gpu-memory-utilization 0.90 \

--max-model-len 203312 \

--trust-remote-code \

--served-model-name Qwen/Qwen3.6-35B \

--host 0.0.0.0 \

--port 8000 \

--enable-auto-tool-choice \

--tool-call-parser qwen3_coder \

--enable-chunked-prefill \

--max-num-seqs 64 \

--kv-cache-dtype fp8 \

--reasoning-parser qwen3 \

--default-chat-template-kwargs '{"thinking": true,"preserve_thinking": true}' \

--api-key sk-xxxxxxx

StandardOutput=append:/DATA/app/vllm/logs/vllm.log

StandardError=append:/DATA/app/vllm/logs/vllm.log

# 【关键】彻底杀死所有进程(包括双显卡worker)

KillMode=control-group

KillSignal=SIGINT

TimeoutStopSec=10

SendSIGKILL=yes

# 自动重启

Restart=on-failure

RestartSec=2

LimitNOFILE=65535

[Install]

WantedBy=multi-user.target刷新服务

shell>>>sudo systemctl daemon-reload

shell>>>sudo systemctl status vllm-qwen

shell>>>sudo systemctl start vllm-qwen

shell>>>sudo systemctl stop vllm-qwen

shell>>>sudo systemctl restart vllm-qwen日志切割

shell>>>sudo crontab -e

0 3 * * * su admin-xy -c "cp /DATA/app/vllm/logs/vllm.log /DATA/app/vllm/logs/vllm.log.$(date +\%Y\%m\%d) && truncate -s 0 /DATA/a>大功告成,如果你需要执行,可以直接运行

三、Openclaw配置请查看之前的文章

略